Puede que te hayas hecho esta pregunta alguna vez mientras cargabas cientos de fotos en la nube o descargabas archivos enormes: ¿la información tiene peso? ¿Tiene masa? ¿Qué lugar ocupa, más allá del disco duro?

Aunque parezca filosófica, esta pregunta tiene una respuesta científica: la información tiene un coste físico. Desde la termodinámica hasta los agujeros negros, la física nos dice que guardar, borrar o transmitir información implica energía… y por tanto, consecuencias reales en el universo.

La información no es solo digital

En informática, la información suele representarse en bits: unidades binarias que pueden tomar los valores 0 o 1. Pero un bit no es solo un símbolo abstracto. Si queremos almacenarlo o modificarlo, necesitamos un soporte físico: un átomo, un electrón, una corriente.

Un bit es siempre una propiedad física de algún sistema. No puede existir “en el vacío”. Y esto tiene implicaciones.

Entropía e información: un vínculo inesperado

Claude Shannon, considerado el padre de la teoría de la información, propuso en 1948 que la cantidad de información se puede medir de forma matemática, y su fórmula para la entropía informacional se parece notablemente a la entropía física:

-

Entropía de Shannon:

-

Entropía de Boltzmann:

Ambas cuantifican el grado de desorden o incertidumbre. En otras palabras: cuanta más información desconoces, mayor es la entropía. Esta relación no es solo formal: la información y la energía están físicamente conectadas.

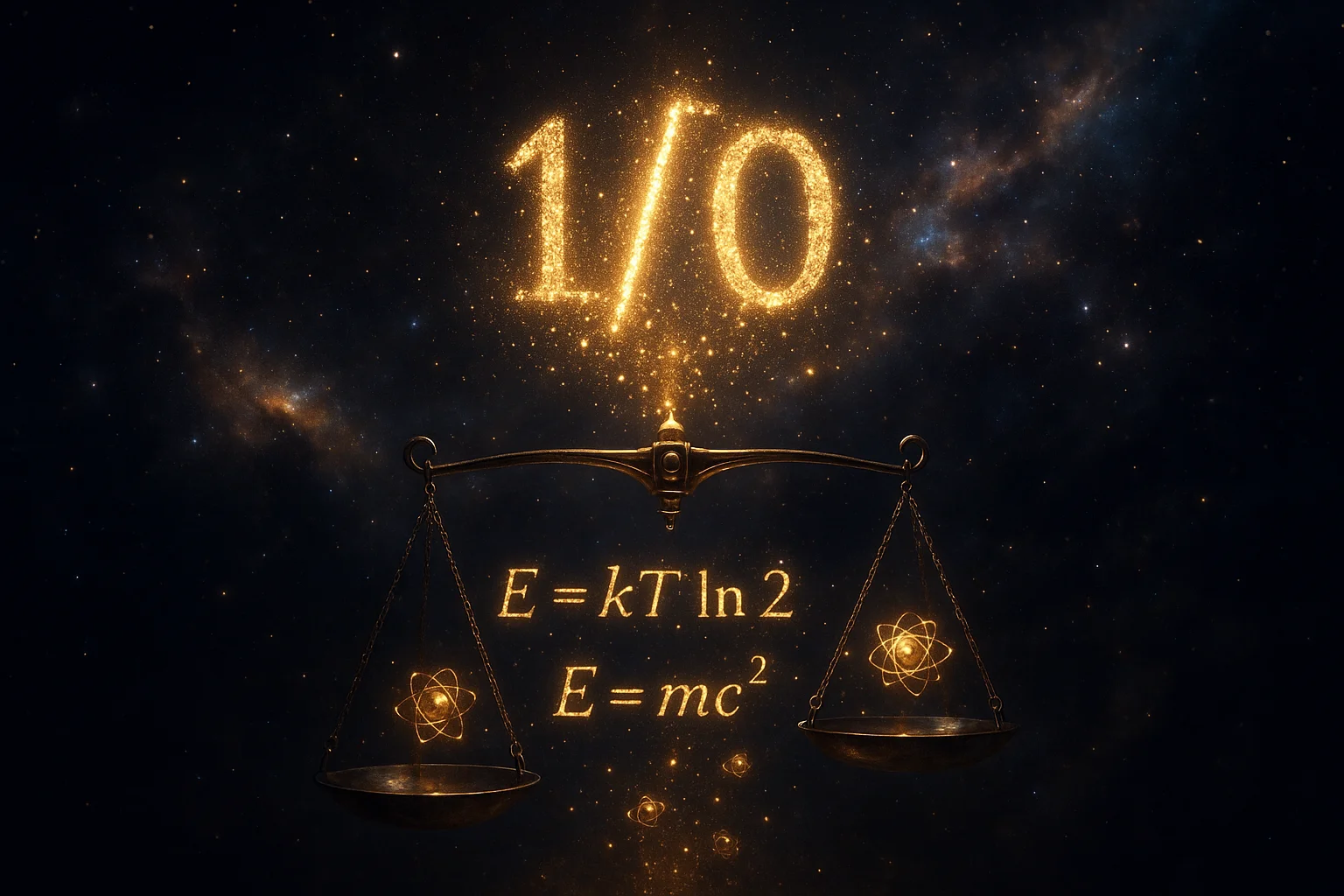

La ley de Landauer: borrar cuesta energía

En 1961, el físico Rolf Landauer formuló un principio revolucionario: borrar un bit de información conlleva inevitablemente un coste energético mínimo. No almacenar, ni leer… solo borrar.

Ese coste es:

donde:

-

k es la constante de Boltzmann,

-

T es la temperatura en kelvins.

A temperatura ambiente (~300 K), equivale a unos 3 x 10-21 julios por bit. Aunque minúscula, esta cantidad marca un límite termodinámico fundamental: la manipulación de información nunca puede ser completamente gratuita.

¿Puede pesar un bit?

El “peso” de la información se relaciona indirectamente con la energía necesaria para procesarla. Gracias a la famosa ecuación de Einstein, E=mc², podemos asociar a cada bit una masa equivalente. A temperatura ambiente, un bit “pesa” alrededor de 3 x 10-38 kilogramos.

Ejemplo tangible: para que 1 TB de datos (8 × 10¹² bits) “pesara” un solo gramo, necesitaríamos almacenarlo a 1 x 1026 kelvins, ¡una temperatura 10 órdenes de magnitud superior a la del Big Bang (~10³² K)!

El tiempo también cuenta: teorema de Margolus-Levitin

No solo importa la energía: también el tiempo mínimo necesario para procesar información está ligado a ella. El teorema de Margolus-Levitin (1998) establece que:

Es decir, cuanta más energía se invierte, más rápido se puede manipular un bit. Esto pone un límite fundamental a la velocidad de cualquier procesador físico.

Agujeros negros e información: la paradoja de Hawking

En 1974, Stephen Hawking demostró que los agujeros negros no son completamente oscuros: emiten una radiación térmica con espectro de cuerpo negro, conocida como radiación de Hawking. Y por tanto, pueden evaporarse con el tiempo.

Esta radiación es térmica —no lleva información codificada—, lo que profundiza la paradoja: si el agujero se evapora totalmente, ¿la información se pierde?

Aquí nace una tensión entre dos pilares de la física:

-

Según la mecánica cuántica, la evolución del sistema es unitaria: la información no puede destruirse.

-

Pero en relatividad general, el agujero negro puede desaparecer… y con él, todo lo que contenía.

Esta contradicción se conoce como la paradoja de la información de los agujeros negros.

Se han propuesto muchas posibles soluciones: que la información se guarda en el horizonte de sucesos, que se codifica en la radiación emitida, o que emerge de una futura teoría cuántica de la gravedad. Pero por ahora, nadie sabe con certeza dónde va a parar esa información.

Conclusión: la era del bit tiene consecuencias físicas

Lo que antes parecía una abstracción matemática —la información— hoy sabemos que tiene:

-

Un coste energético (ley de Landauer)

-

Un límite temporal de procesamiento (teorema de Margolus-Levitin)

-

Una masa equivalente (vía E=mc²)

-

Una conexión profunda con la entropía

-

Un papel clave en la computación, la termodinámica y la cosmología

Así que sí: la información “pesa”. No en gramos… pero en energía, en tiempo, en orden… y quizás, en el destino del universo.

Como dijo el físico John Archibald Wheeler, creador del término “agujero negro” y pionero de la teoría de la información cuántica:

“Todo es información.”